A OpenAI acaba de apresentar dois novos modelos de inteligência artificial: o o3 e o o4-mini. Ambos foram desenvolvidos com foco em processamento visual avançado, ou seja, a capacidade de analisar e interpretar imagens com maior precisão e profundidade.

Por isso, essa novidade representa um avanço significativo na forma como sistemas de IA enxergam e compreendem o mundo visual.

O que muda com os modelos o3 e o4-mini da OpenAI

O lançamento dos modelos o3 e o4-mini acontece em um momento de competição acirrada no mercado de inteligência artificial. Empresas como Google, Anthropic e Meta investem pesado em capacidades multimodais, ou seja, sistemas que conseguem trabalhar com texto, imagem e áudio ao mesmo tempo. Diante disso, a OpenAI precisava responder com algo que mostrasse evolução real em suas ferramentas.

Além disso, o processamento visual avançado não é apenas um recurso técnico interessante. Na prática, ele permite que aplicações identifiquem objetos em fotos, analisem documentos escaneados, interpretem gráficos e até auxiliem pessoas com deficiência visual a entender o ambiente ao redor. Em outras palavras, a visão computacional deixa de ser um recurso de nicho e passa a ter aplicações no dia a dia de milhões de pessoas.

O modelo o3 foi projetado para tarefas complexas que exigem análise visual detalhada. Pense nele como um especialista que consegue olhar para uma imagem médica e identificar padrões sutis, ou analisar uma planta arquitetônica e apontar inconsistências. Por outro lado, o o4-mini oferece capacidades semelhantes em uma versão mais leve e econômica, ideal para aplicações que precisam de velocidade e menor custo de processamento.

Nesse sentido, a estratégia da OpenAI segue um padrão conhecido no setor: oferecer uma versão premium para casos de uso avançados e uma versão acessível para democratizar o acesso à tecnologia. Dessa forma, desenvolvedores com orçamentos diferentes conseguem escolher a opção que melhor atende suas necessidades.

- O modelo o3 foi desenvolvido para análise visual complexa, como interpretação de documentos técnicos e imagens médicas

- O o4-mini oferece processamento visual avançado em formato mais leve, competindo diretamente com soluções como o Gemini Flash do Google

- Ambos os modelos permitem que aplicações entendam contexto visual, não apenas identifiquem objetos isolados

- O processamento visual avançado pode ser integrado a fluxos de trabalho existentes via API da OpenAI

Impacto no mercado e na concorrência global de IA

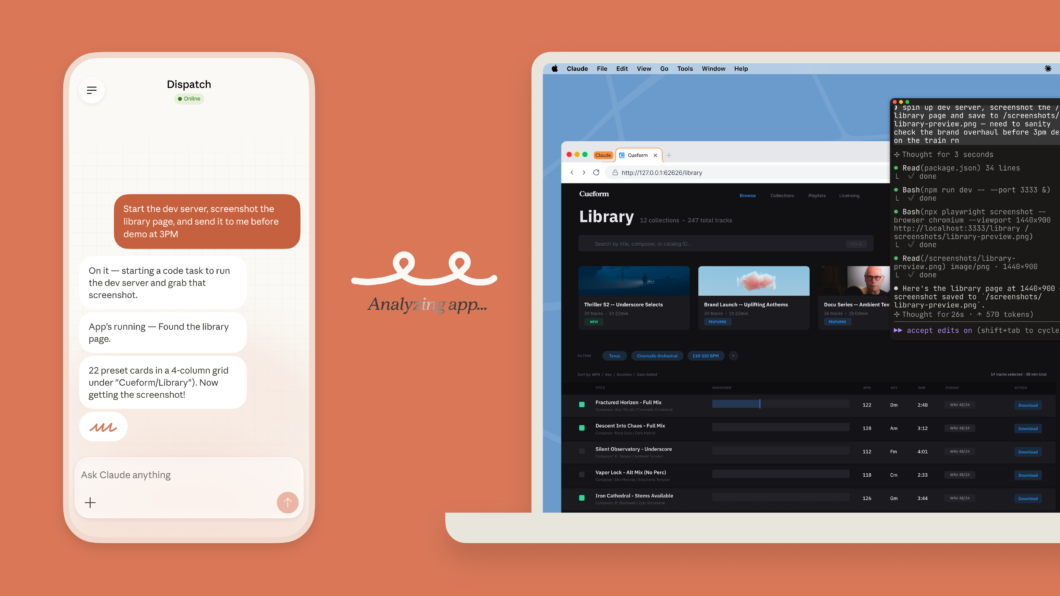

O lançamento do o3 e o4-mini coloca pressão direta sobre concorrentes que também apostam em visão computacional. O Google, com seu Gemini, já oferece capacidades multimodais robustas. A Anthropic, com o Claude, também avança nessa direção. No entanto, a OpenAI mantém uma vantagem importante: a base instalada de desenvolvedores que já usam suas APIs.

Como resultado, empresas que já construíram produtos sobre a infraestrutura da OpenAI podem adotar as novas capacidades visuais sem precisar migrar para outra plataforma. Isso cria um efeito de aprisionamento que dificulta a vida dos concorrentes, mesmo que eles ofereçam tecnologia equivalente ou superior em alguns aspectos.

Apesar disso, o mercado brasileiro ainda enfrenta desafios específicos para adoção dessas tecnologias. O custo de uso das APIs em dólar pesa no orçamento de startups e desenvolvedores independentes. Portanto, a versão o4-mini pode ser especialmente relevante para o público nacional, já que promete entregar resultados consistentes com menor investimento.

Para o usuário final, a evolução nos modelos o3 e o4-mini significa aplicações mais inteligentes no celular e no computador. Pense em um app de banco que consegue ler um comprovante de pagamento apenas com uma foto. Ou um assistente que analisa a foto de um produto e encontra opções similares em lojas online. Inclusive, ferramentas de acessibilidade ganham um salto de qualidade quando a IA consegue descrever cenas complexas com precisão.

Assim sendo, o impacto prático não fica restrito a desenvolvedores ou empresas de tecnologia. Profissionais de diversas áreas, como médicos, engenheiros, designers e educadores, podem se beneficiar de sistemas que entendem imagens com a mesma fluência que entendem texto.

Perguntas frequentes

O que são os modelos o3 e o4-mini da OpenAI?

Os modelos o3 e o4-mini são as novas inteligências artificiais da OpenAI focadas em processamento visual avançado. O o3 é a versão mais robusta, ideal para análises complexas de imagens, documentos e gráficos. Já o o4-mini oferece capacidades semelhantes em formato mais leve e econômico. Ambos representam a evolução da OpenAI em visão computacional, permitindo que aplicações interpretem contexto visual com maior precisão.

Como o processamento visual avançado funciona na prática?

O processamento visual avançado permite que a inteligência artificial analise imagens da mesma forma que analisa texto. Na prática, isso significa que um sistema pode olhar para uma foto e entender não apenas os objetos presentes, mas também o contexto da cena, relações espaciais e até emoções sugeridas. Para o usuário, isso se traduz em apps que leem documentos escaneados, identificam produtos em fotos ou descrevem ambientes para pessoas com deficiência visual.

Fonte: Google News OpenAI

Análise Crítica

A OpenAI segue uma estratégia clara de dominação por camadas. Ao lançar o o3 para casos complexos e o o4-mini para uso massificado, a empresa replica o modelo que funcionou com o GPT-4 e GPT-4o: capturar tanto o topo quanto a base do mercado. O interesse comercial é óbvio, já que desenvolvedores que começam pelo modelo barato dificilmente migram quando escalam. O Google é quem mais perde nesse movimento, pois o Gemini Flash competia justamente no segmento de modelos leves e rápidos. Agora precisa justificar por que alguém escolheria sua solução em vez de permanecer no ecossistema OpenAI.

Para uma agência de marketing digital brasileira, por exemplo, isso significa que automatizar análise de criativos publicitários ficou mais acessível, mas também mais dependente de uma única empresa americana. O padrão aqui é clássico: oferecer ferramenta barata ou gratuita até criar dependência, depois ajustar preços quando a migração se torna custosa demais. A pergunta que a OpenAI preferiria não responder: qual será o aumento de preço do o4-mini quando ele se tornar essencial para milhões de aplicações?

A visão do canal Invente com IA

Se você trabalha com conteúdo visual, presta atenção nisso aqui. O o4-mini da OpenAI pode ser a ferramenta que faltava pra automatizar análise de imagens sem estourar o orçamento. Pensa no seguinte: você consegue criar um fluxo onde o cliente manda foto de um produto e seu sistema já identifica categoria, sugere descrição e até compara com concorrentes. Isso antes precisava de modelo caro ou integração complexa. Nos próximos 30 dias, vale testar a API do o4-mini pra um caso de uso específico do seu negócio. Começa simples, tipo analisar thumbnails ou ler prints de métricas. O resultado esperado é entender se o custo fecha pra sua operação antes de escalar.